DeepSeek给AI装了根赛博手指, 于是它能看见了

五一假期前一天,DeepSeek已而扔出来一份视觉多模态工夫讲演。

点开之前,我心里粗略是有个预期的,无非即是具体能看到多远、看得多了了。

毕竟往日一年,多模态模子基本都在往这个场地卷。OpenAI讲thinking with images,让模子在推理过程中剪辑、放大、旋转图片;Gemini、Claude也都在想宗旨让模子处理更高区分率、更复杂的视觉输入。

公共的共同假定是,只须模子看得更细,视觉推理天然就会更强。

但DeepSeek这份讲演看下来,你会发现,他们十足走上了另一条路。

DeepSeek莫得把要点放在“让模子看到更多像素”上,他们把详确力放在了一个更底层的问题上。

就算模子一经看了了了,但是它在推理过程中,你若何能保证模子和你指的是统一个东西?

其实这是多模态推理里最容易被忽略的死穴。

东谈主类看图时,不错用手指去象征对象。比如“这个东谈主是谁谁谁”、“阿谁东谈主是谁谁谁”。但模子哪知谈你说的这个是哪个?

模子只可用谈话说“左边阿谁”“上头阿谁”“这条线”。一朝画面复杂起来,谈话指代就会漂移,推理也会随着崩。

于是DeepSeek就说了,那就给模子一根“手指”不就完毕?

它把点和领域框变成模子念念考时的基本单元,让模子能够一边用这根赛博手指指着对象,一边进行推理。

01

从一语气视觉到打破象征

DeepSeek在这份工夫讲演里,建议了一个很挑升念念的问题。他们认为,多模态模子简直难的地方,不是看见图像,而是在一语气推理过程中踏实地指向统一个视觉对象。

就比如你跟你的一又友说“菜市集里,张老老婆的阿谁摊位卖的菜最簇新”。但是菜市集里老翁老老婆多了去了,哪个是张老老婆?

但若是你胜利用手指着说“即是阿谁”,你一又友就会立地明白。

DeepSeek将这个问题定名为“援用鸿沟”(Reference Gap)。

往日一年,险些通盘前沿多模态模子都在责罚“感知鸿沟”(Perception Gap)这个问题。

假如说有一张像片放在你眼前,若是像片太朦拢、区分率太低,你可能看不了了里面的小字或者边远的细节。AI也一样,若是输入的图像质料不够、处理神志分歧,它就会“看不清”,这即是感知鸿沟。

GPT、Claude、Gemini这些模子不断提高区分率,引入高区分率剪辑、动态分块、多范例处理,贪图即是让模子能看到更多细节。

这个场地天然有价值,但DeepSeek在讲演里指出,就算模子看得再了了,在复杂的空间推理任务上,仍然会出现逻辑崩溃。

问题出在天然谈话自身。

像片里有十几只狗,你说“左边那只狗”,那模子就没宗旨瓦解你说的具体是哪只。

还有更绝的,若是你让模子数一下像片里狗的数目,那么模子在推理过程中很容易就搞不了了我方一经数过哪些、还有哪些没数。

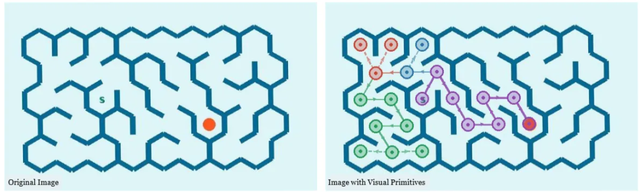

讲演中还提到了迷宫导航这么极点的情况,纯谈话根柢无法准确态状不次第模式的旅途和复杂的拓扑关系。

谈话当作一种指代用具,在一语气的视觉空间里天生即是朦拢的。它擅长玄虚见解和因果关系,但在空间定位和拓扑关系上,谈话的抒发智商存在根人道的局限。

可DeepSeek自身即是个通用的谈话模子,那应该若何责罚呢?

于是就有了著述来源提到的这根“手指”。

他们建议的中枢见解是“视觉基元”(Visual Primitives),具体来说即是把领域框(bounding boxes)和点(points)这两种计算机视觉里最基础的空间象征,提高为“念念维的最小单元”。

以前的多模态模子天然也能画框标注物体,但仅仅在终末给你看个收尾,讲解“我找到了”。就像测验时,你只交谜底,不写解题过程。

也有一些盘问让AI在念念考过程中画框,但贪图仅仅为了“看得更准”,框框仅仅个扶助用具。就好比你作念数学题时用草稿纸,草稿纸仅仅帮你算得更了了,不是解题念念路的一部分。

DeepSeek要作念的十足不同。

他们把这些空间象征胜利镶嵌到模子的推理过程中,让它们成为推理的有机构成部分。模子在念念考的期间,不仅仅用谈话态状“我看到了一只狗”,还同期输出“我看到了一只狗,它在这里:[[x1,y1,x2,y2]]”。

这个机制被DeepSeek称为“边推理边指向”(point while it reasons)。

模子的每一步念念考都锚定在图像的具体坐标上。

工夫讲演里就给了这么一个例子:模子从滥觞动身,一齐探索、回溯、再尝试,终末输出了一串完整的坐标旅途,每个坐标都对应迷宫里走过的一个点。

这么一来,188金宝博官网app下载模子就不会在推理过程中“迷途”。它不会搞不了了我方在说什么、指什么。每个视觉对象都有了明确的空间锚点,推理过程变得可跟踪、可考证。

这条工夫道路和OpenAI的场地造成了真义的对比。

OpenAI在o3和o4-mini的官方先容里明确提到了“thinking with images”的见解,即模子不错把图像纳入推理链,并通过剪辑、放大、旋转等神志处理图像。这个场地的要点是让图像自身成为念念维链的一部分,模子不错在推理过程中生成新的图像、修改图像、对图像进行操作。

OpenAI的道路强调的是通用智商,视觉、代码、搜索、文献、用具调用一齐调解。模子领有一个庞大的“视觉责任台”,不错机动地处理千般视觉任务。

DeepSeek的道路则更“象征化”少量。它让坐标投入念念维链。模子在推理文本里显式写出领域框和点的坐标,把视觉对象变成推理时可复用的锚点。

这就导致,OpenAI的视觉推剃头生在里面,用户只可看到最终谜底和必要解释,中间的视觉处理过程是黑箱。DeepSeek则成心把中间视觉锚点显式化,让推理过程十足透明。

DeepSeek这么作念,克己是推理过程更容易被教师、查验和打分。这也让它更容易设想模式、质料和任务级奖励。尤其在迷宫、旅途跟踪这类任务中,不错对旅途正当性、轨迹阴私度等给出更细的反馈。

模子不仅仅学会输出正确谜底,更是学会了用视觉基元进行推理的方法。

02

效用才是中枢

DeepSeek这份讲演里有一个很容易被忽略但极其病笃的细节,他们的模子在处理图像时,用的token数目远远少于其他前沿模子。

讲演里有一张对比图,展示了不同模子处理一张800×800区分率图像时销耗的token数目。

Gemini-3-Flash约1100个,Claude-Sonnet-4.6约870个,GPT-5.4约740个,Qwen3-VL约660个,DeepSeek约361个,并在KV缓存里只保留约90个条件。

这个差距不是少量点。DeepSeek用的token数目唯有Gemini的3分之1,KV缓存条件更是唯有10分之1操纵。

这种极致的效用是若何达成的?

DeepSeek用了一个叫“压缩疏淡详确力”(Compressed Sparse Attention, CSA)的机制。

你不错这么瓦解,假如说你给一又友看一张全家福,你不会说“从左数第237个像素运转有一块红色区域……”,你会胜利说“左边是我妈,右边是我爸”。

DeepSeek-ViT先把图像压成更少的视觉token,CSA再把这些视觉token在KV缓存中的示意进一步压缩。

这个机制在DeepSeek-V4-Flash模子上就使用过,当今被诳骗到了视觉多模态之中。

具体的压缩进程是这么的。一张756×756的图像,包含571536个像素。这些像素最初经过ViT处理,以14×14的patch size切分,生成2916个patch token。然后进行3×3的空间压缩,把每9个相邻的token沿着通谈维度压缩成1个,变成324个视觉token。

这324个token投入大谈话模子进行预填充。终末,CSA机制会把这些视觉token在KV缓存里再压缩4倍,最终只保留81个条件。

从571536个像素到81个KV缓存条件,通盘这个词压缩比达到了7056倍。

一般AI大厂都是在用暴力方法去堆计算资源,而DeepSeek则是在信息论层面去作念接管,只留住最直不雅易懂的信息。

其最胜利的收尾,即是推理速率变快了许多。

图像token数目胜利影响模子的推理蔓延。在自追想生成过程中,每生成一个新token,模子都需要对之前通盘token的KV缓存进行详确力计算。若是图像占用了1000个token,那么每次生成都要对这1000个token作念详确力。若是只占用90个,计算量就大幅减少。

关于需要及时反映的诳骗场景,比如机器东谈主视觉、自动驾驶、及时视频分析,推理速率的提高起到了决定性作用。

然后它内存占用得也少。

KV缓存是大模子推理的内存瓶颈。稀奇是在处理长高下文或批量推理的期间,KV缓存会占用无数显存。DeepSeek把视觉token的KV缓存压缩到90个条件,意味着不错在相同的硬件上处理更多图像,或者处理更长的多轮对话。

这关于履行部署止境病笃。好多公司的多模态模子在实验室里发达很好,但一到履行部署就遭遇资本问题。每张图片销耗的token越多,推理资本就越高,可维持的并发用户就越少。DeepSeek的效用上风在领域化部署时会被放大。

同期也变相提高了模子的高下文容量。

若是一张图片要占用1000个token,那么在一个128k的高下文窗口里,只可放100多张图片。若是只占用300个token,就不错放400多张。这关于需要处理多图对话、长视频分析、无数文档瓦解的场景至关病笃。

DeepSeek的模子不错在一个对话里处理更多图像,不错对比分析几十张以致上百张图片,不错跟踪视频里的经久变化。

最关键的是教师资本。

天然讲演主要讲推理效用,但这种压缩机制在教师阶段相同有用。更少的视觉token意味着更小的计算图,更快的教师速率,更低的硬件要求。

DeepSeek一直以“用更少资源作念出更好成果”著称。从R1的强化学习教师,到V4的MoE架构,再到当今的视觉多模态,这种效用优先的形而上学皆集经久。

但这里有一个关键问题。压缩会不会亏欠信息?

DeepSeek并莫得否定压缩会带来信息亏欠。它的主张是,在这组空间推理和计数任务上,压缩后的表征仍然实足有用。

每一步压缩都在保留对推理最病笃的信息,丢弃冗余和噪声。

其实前边提到的DeepSeek的视觉基元机制,它自身亦然一种信息压缩。一个领域框用4个数字就能精准信位一个物体,一个点用2个数字就能象征一个位置。这些打破象征佩戴的信息密度远高于原始像素。

从实验收尾看,这种压缩莫得挫伤性能,反而在某些任务上带来了提高。

这证据关于好多视觉推理任务,瓶颈不在于看得不够了了,而在于莫得找到相宜的表征神志。

这种效用上风还讲解了多模态智能不一定需要更大的模子、更多的算力、更高的资本。

从DeepSeek时刻出生于今,这家公司一直有一条暗线,“简直的智能不在于算力,而在于对问题履行的瓦解”。

当你简直瓦解了视觉推理需要什么,你就不需要那么多token。当你找到了相宜的表征神志,你就不需要那么大的模子。

从这个角度看,DeepSeek的极致效用不是贪图,而是副居品。简直的贪图是找到视觉推理的正确范式。效用仅仅讲解了这个范式是对的。

03

未竟之事

DeepSeek在讲演的局限性部分,坦诚地列出了现时列法存在的几个问题。这些问题不是工夫细节上的小弊端,而是指向了视觉推理的下一个阶段。

第一个问题是触发词依赖。

讲演里明确说,现时的“用视觉基元念念考”智商需要显式的触发词(explicit trigger words)智力激活。也即是说,模子还不成天然、自主地决定“什么期间该画框、打点”。

它意味着模子还莫得简直学会判断什么期间需要使用视觉基元,什么期间用谈话就够了。

理想的情况是,模子应该能证据任务的性质自主决策。但当用户问“数一数图里有几只狗”的期间,模子应该自动切换到视觉基元模式,用领域框来扶助计数。

从工夫上说,这需要在模子里成就一个元领路层。这个元领路层不错评估现时任务的复杂度,判断纯谈话推理是否实足,决定是否需要调用视觉基元。

DeepSeek目下还莫得达成这个元领路层,但他们一经明确了场地。将来的版块可能会让模子学会自主决定推理政策,而不是依赖外部触发。

第二个问题是区分率收尾。

讲演提到,受输入区分率收尾,模子在细粒度场景下的发达还不够好,输出的视觉基元随机不够精准。

这个问题和DeepSeek的效用优先政策关联。为了适度token数目,他们收尾了视觉token的范围在81到384之间。关于超出这个范围的图像,会进行缩放处理。

这种设想在大部分场景下是合理的,但在一些需要极高精度的任务上就会遭遇瓶颈。比如医疗影像分析需要识别微小的病灶,工业质检需要发现轻飘的弊端,这些场景对区分率的要求很高。

DeepSeek在讲演里提到,这个问题不错通过整合现存的高区分率方法来责罚。也即是说,他们的视觉基元框架和传统的高区分率剪辑方法不是对立的,而是互补的。

我以为DeepSeek不错出个混杂决策。

具体即是关于大部分惯例任务,使用压缩的视觉表征和视觉基元推理,保执高效用。关于需要细粒度分析的局部区域,动态调用高区分率剪辑,索求更详备的视觉信息。这么既保执了举座效用,又知足了局部精度需求。

这种混杂决策的关键是让模子学会判断哪些区域需要高区分率处理。于是这就又回到了刚才元领路的问题上。

第三个问题是跨场景泛化。

讲演提到,用点当作视觉基元来责罚复杂拓扑推理问题仍然很难,模子的跨场景泛化智商有限。

这个问题在迷宫导航和旅途跟踪任务上发达得相比昭彰。天然DeepSeek在我方构建的测试集上达到了66.9%和56.7%的准确率,突出了其他模子,但这个数字自身还不够。

更病笃的是,这些任务都是在合成数据上教师和测试的。迷宫是用算法生成的,旅途跟踪的弧线亦然设施化绘画的。当模子遭遇简直寰宇里的拓扑推理问题时,比如在简直舆图上贪图旅途,在复杂管线图里跟踪皆集关系,发达可能会下落。

DeepSeek的方法是通过大领域、高千般性的数据来提高泛化智商。他们爬取了97984个数据源,经过严格过滤后保留了31701个,最终赢得突出4000万个样本。在迷宫和旅途跟踪任务上,他们也设想了多种拓扑结构、视觉作风、难度品级,试图阴私尽可能多的变化。

关联词数据千般性仅仅泛化智商的一部分。模子是否简直瓦解了拓扑推理的履行?如故说它仅仅记取了教师数据里的模式良友?

另外,DeepSeek的视觉基元是一套新的表征系统,需要专门的数据模式、教师进程、评估方法。这和现存的多模态生态不十足兼容。

大部分多模态数据集和评测基准都是基于传统的“图像+文本”范式设想的,莫得推敲视觉基元。若是要在这些基准上评测DeepSeek的模子,要么需要关闭视觉基元功能,要么需要从头设想评测方法。

其他盘问者若是想复现或矫正这个责任,需要从头构建通盘这个词数据和教师进程,门槛相比高。

DeepSeek能在讲演中谈及这些问题,证据他们对我方的责任有清亮的果断。

这可能比给出齐全谜底更有价值。因为简直鼓励社会跳动的,经常不是谜底,而是问题。

杏彩(XingCai)官网平台热点资讯

- 安博AnBo(中国) 霸州x华为: 立一个存力支点, 撬动华

- DeepSeek给AI装了根赛博手指, 于是它能看见了

- 安博app(中国)官方网站 宝妈的超市一月倒闭,卖老公像片抱

- 鹰眼预警: 国中水务应收账款增速高于生意收入增速

- 安博app官方网站 OpenAI 硬件讲求东说念主闭门共享,

- 安博app(中国)官方网站 心智不雅察所: “总共东说念主都

- 2026旗舰游戏本天花板? HyperX阴影精灵MAX 旗舰

- 安博app(中国)官方网站 AI从“炫技”转向“算账”, T

- 安博app(中国)官方网站 国产物牌的工业策画, 到了什么阶

- AI搏斗中的“东说念主类监督”是一种幻觉